第10章 LLMとLLMOの将来 LLMとLLMOpsの未来

この作品はAIを使って翻訳されている。ご意見、ご感想をお待ちしている:translation-feedback@oreilly.com

LLMOps、LLM、NLP、そしてナレッジグラフの未来は、今後10年間で、現在ではほとんど想像もつかないような形で収束していくだろう。AIシステムはもはや遠い道具ではなく、私たちの生活のあらゆる面に深く統合されていることを想像してほしい。現在最も人気のあるLLMでさえ、やや不便なイテレーションだが、近い将来、LLMの言語理解は人間の直感に匹敵するところまで洗練されると私は信じている。これは、LLMの特質が出現しているからだ。

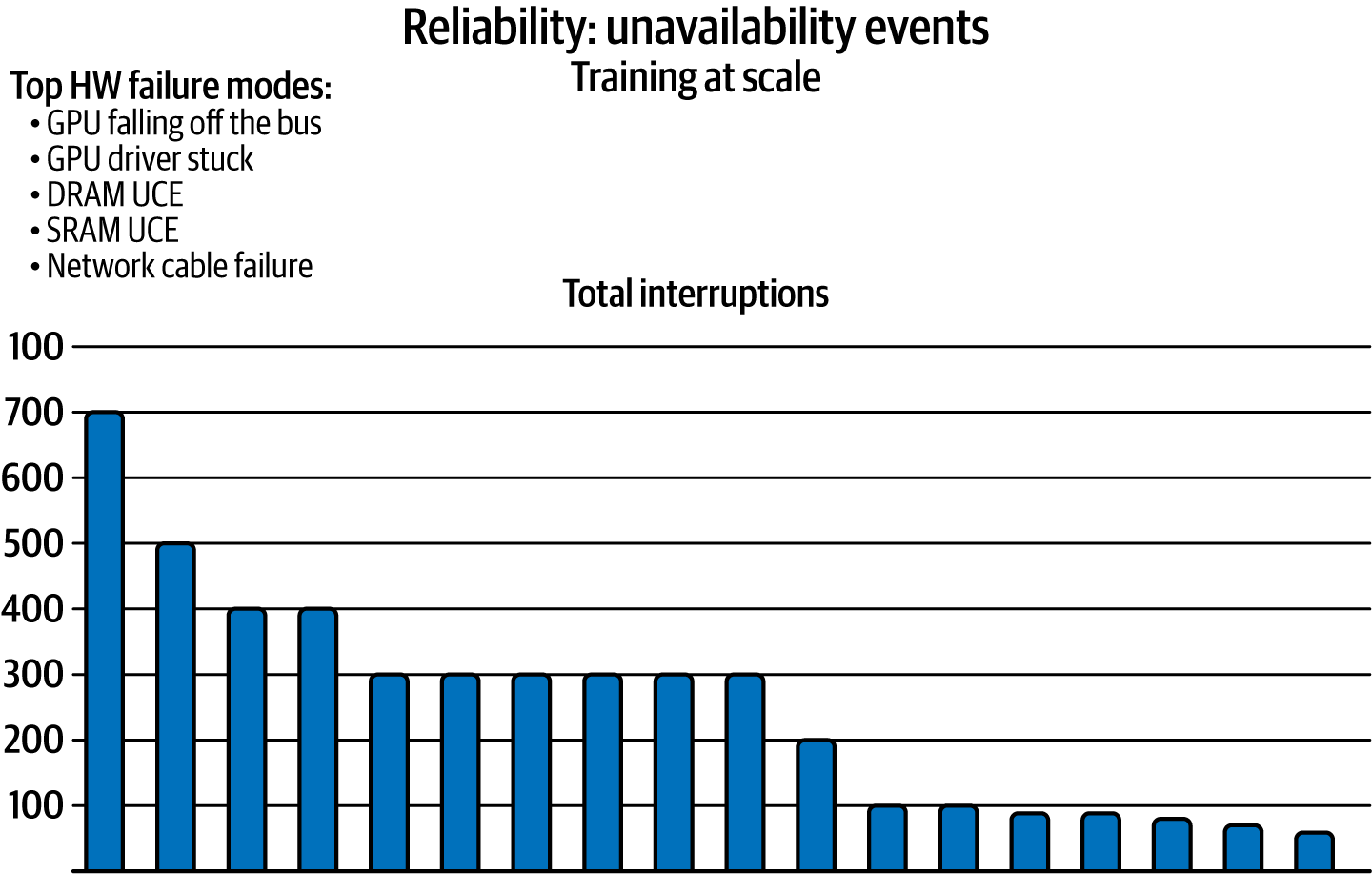

現在、ユーザがLLMとやり取りする主な方法はテキストベースのチャットだが、数年後には、LLMは単に質問に答えるだけでなく、複雑な問題解決に関与し、洞察を提供し、創造性そのものの限界を押し広げるようになるだろう。例えば、2024年9月、OpenAIはChatGPTアプリケーション向けにAdvanced Voice Mode (皮肉を含む声のトーンを検出できる)をリリースした。この作業の多くは、インフラスタック全体の差し迫った革新に関連している。Metaは最近、これらのモデル( )を大規模にトレーニングする際に生じる、アルゴリズムやアーキテクチャを超えた問題について書いた(図10-1参照)。

LLMOpsは、これらのシステムがシームレスで自立的なインフラに成熟するのを支えるバックボーンとなるだろう。手作業の代わりに、これらのモデルのトレーニング、ファインチューニン グ、デプロイのためのパイプラインが完全に自動化され、この分野の進歩がスピードアップする。LLMOpsのエンジニアは、コードのデバッグに費やす時間を減らし、モデルのトレーニングと計算コストのバランスを自動的にとるプラットフォームやインフラ設計など、高レベルのシステム戦略を洗練させることに時間を費やすようになる。

図10-1. 信頼性はLLMOpsの重要な目標であるが、インフラレベルでさらなるイノベーションが必要なため、Meta社でさえ苦戦している(出典:Engineering at Meta; 許可を得て使用)。

これらのモデルはその場で適応し、ほとんど魔法のように感じられる速度で実世界のフィードバックから学習する。これは、MLにおける活発な研究分野であるAutoMLの主な目標である。最も重要なのは、LLMがより高品質の翻訳コンテンツを生成し始めると、LLMはその能力を、一般的でない言語にも、より簡単に拡張できるようになることだ。図10-2)は、LLMがマルチモーダル入力を使いこなすようになりつつあることだ。現在、LLMがテキスト、音声、画像を処理するのに要する時間は数秒であり、 音声合成翻訳に向けた重要なステップである音声テキスト同時翻訳において、多くの進歩が見られる。同時音声テキスト翻訳の品質が十分に高まれば、OpenAI Whisperのような既存の音声合成モデルを使用して音声合成翻訳パイプラインを完成させることができる。

図10-2. 2024年9月24日、OpenAIの研究担当副社長時代のバレット・ゾフによるXの投稿

LLMの限界の一つは、LLMはトレーニングデータと送信されたプロンプトに基づいて、次に来る可能性の高い単語を生成するが、単純な概念さえも理解していないように見えることだ。人気のある例( ...

Become an O’Reilly member and get unlimited access to this title plus top books and audiobooks from O’Reilly and nearly 200 top publishers, thousands of courses curated by job role, 150+ live events each month,

and much more.

Read now

Unlock full access