Capitolo 1. Applicazioni LLM

Questo lavoro è stato tradotto utilizzando l'AI. Siamo lieti di ricevere il tuo feedback e i tuoi commenti: translation-feedback@oreilly.com

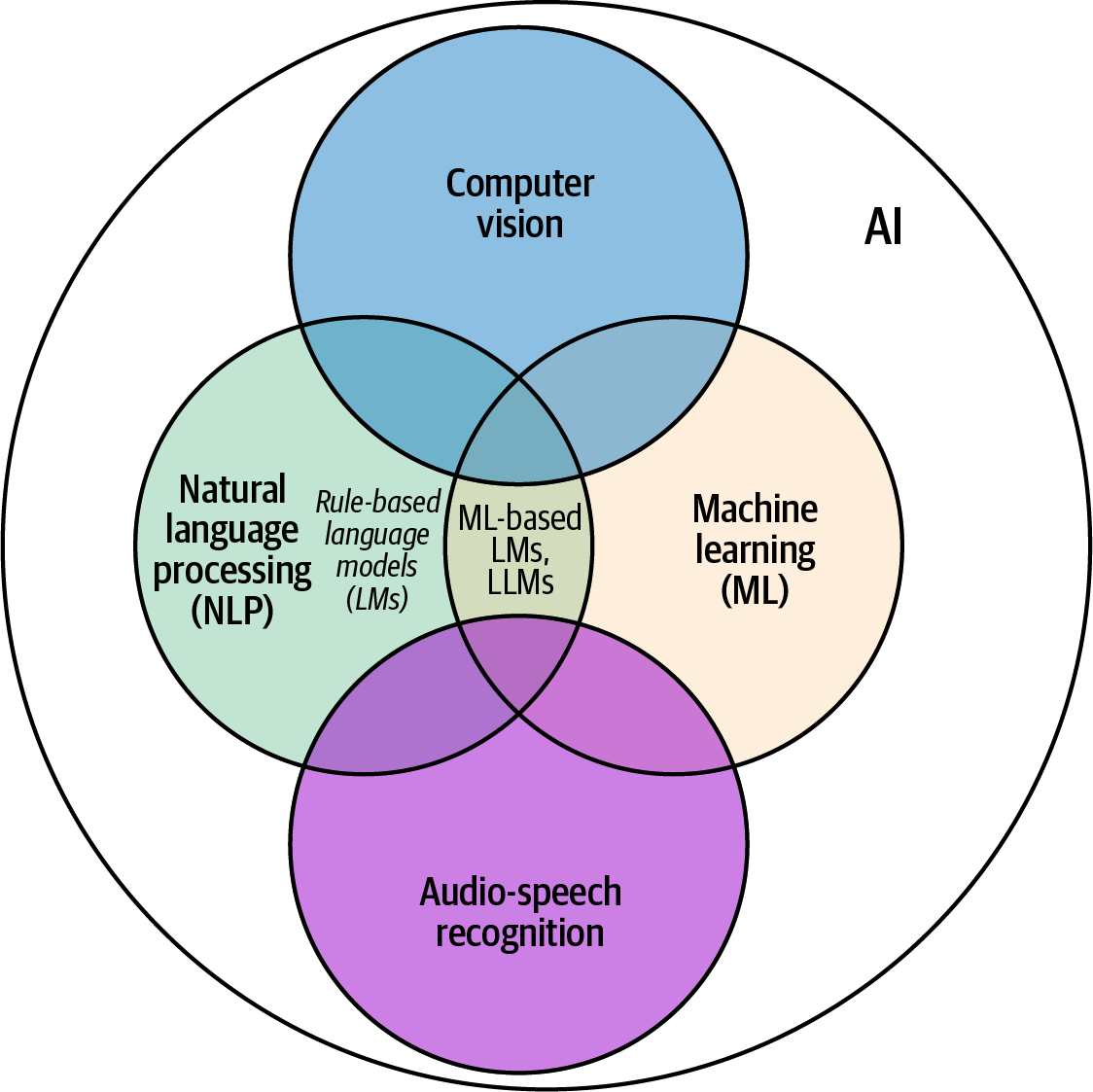

Un modello linguistico di grandi dimensioni (LLM) è un modello statistico addestrato su grandi quantità di dati testuali per emulare il parlato umano per compiti di elaborazione del linguaggio naturale(Figura 1-1), come l'estrazione di informazioni, la classificazione di testi, la sintesi vocale, il riassunto e la traduzione automatica. LLMOps, quindi, è un framework per automatizzare e semplificare le pipeline di modelli linguistici di grandi dimensioni (chiamati anche modelli fondativi o generativi dell'intelligenza artificiale ).

Sebbene i modelli specifici per l'elaborazione del linguaggio naturale (NLP) siano stati utilizzati nella pratica per un po' di tempo, i recenti progressi nel campo dell'NLP hanno spostato l'interesse del pubblico verso modelli più "task-agnostici" che consentono a un singolo modello di svolgere tutti i compiti elencati nel paragrafo precedente.

Figura 1-1. Un diagramma di Venn che spiega la correlazione tra AI, ML e LLMs1

I modelli LLMs utilizzano un gran numero di parametri (variabili che memorizzano i modelli di input-output nei dati per aiutare il modello a fare previsioni): LLaMA, un LLM sviluppato da Meta, contiene 65 miliardi di parametri; PaLM, di Google, ne ha 540 miliardi; ...

Become an O’Reilly member and get unlimited access to this title plus top books and audiobooks from O’Reilly and nearly 200 top publishers, thousands of courses curated by job role, 150+ live events each month,

and much more.

Read now

Unlock full access