Capítulo 4. Usando LangGraph para adicionar memória ao teu Chatbot

Este trabalho foi traduzido com recurso a IA. Agradecemos o teu feedback e comentários: translation-feedback@oreilly.com

No Capítulo 3, aprendeste a fornecer à tua aplicação de chatbot de IA um contexto atualizado e relevante. Isto permite que o teu chatbot gere respostas precisas com base na entrada do utilizador. Mas isso não é suficiente para criar uma aplicação pronta para produção. Como podes permitir que a tua aplicação "converse" com o utilizador, recordando conversas anteriores e contexto relevante?

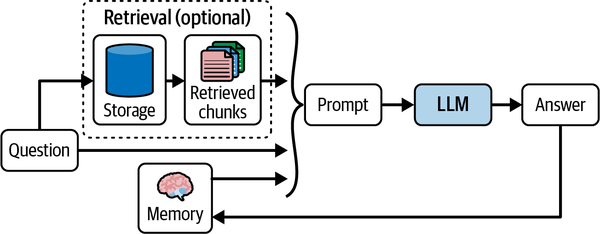

Os grandes modelos linguísticos são stateless, o que significa que, sempre que o modelo é solicitado a gerar uma nova resposta, não tem memória do prompt anterior ou da resposta do modelo. Para fornecer esta informação histórica ao modelo, precisamos de um sistema de memória robusto que mantenha o registo de conversas e contextos anteriores. Esta informação histórica pode então ser incluída no prompt final enviado ao LLM, dando-lhe assim "memória". A Figura 4-1 ilustra esta situação.

Figura 4-1. Memória e recuperação utilizadas para gerar respostas contextualizadas a partir de um LLM

Neste capítulo, aprenderás a construir este sistema de memória essencial usando os módulos integrados do LangChain para facilitar o processo de desenvolvimento.

Criar um sistema de memória de chatbot

Existem duas decisões de design ...

Become an O’Reilly member and get unlimited access to this title plus top books and audiobooks from O’Reilly and nearly 200 top publishers, thousands of courses curated by job role, 150+ live events each month,

and much more.

Read now

Unlock full access