第2章 AI システムハードウェアの概要

この作品はAIを使って翻訳されている。ご意見、ご感想をお待ちしている:translation-feedback@oreilly.com

スーパーコンピュータ級のAIハードウェアを単一のラックに凝縮すると想像してみろ。NVIDIAの最新アーキテクチャはまさにそれを実現した。この章では、がCPUとGPUを強力なスーパーチップに融合し、さらにそれらを数十個超高速インターコネクトで接続してAIスーパーコンピュータを箱に作成した仕組みを掘り下げる。基本的なハードウェア構成要素であるGrace CPUとBlackwell GPUを探求し、それらの緊密な統合と巨大なメモリプールがAIエンジニアの作業をいかに容易にするかを検証する。

次に、72個のGPUを単一のマシンのように連結するネットワークファブリックへと視野を広げる。その過程で、このシステムに超能力をもたらす演算性能、メモリ容量、効率性における飛躍的な進歩を強調する。最終的には、この最先端ハードウェアが、これまで不可能と思われていた数兆パラメータ規模のモデルのトレーニングとサービングをいかに可能にするかを理解できるだろう。

CPUとGPUのスーパーチップ

NVIDIAの AIスケーリング戦略は、単一の統合型CPU+GPUスーパーチップモジュールから始まる。Hopper世代以降、NVIDIAはARMベースのCPUと1つ以上のGPUを同一ユニットにパッケージ化し、高速インタフェースで緊密に連携させた。その結果、単一のモジュールが統合コンピューティングエンジンとして動作するようになった。

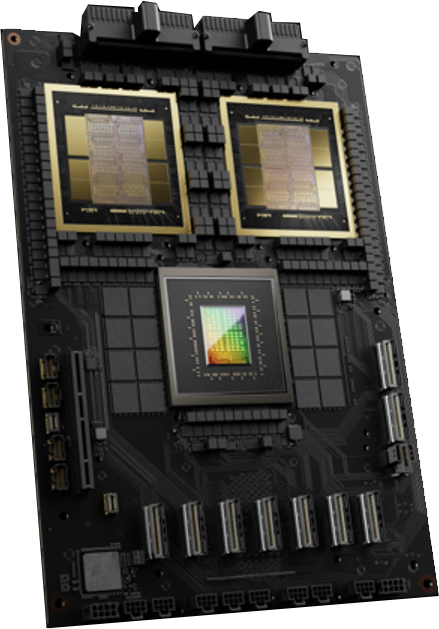

スーパーチップ の最初の実装はGrace Hopper(GH200)であり、1つのGrace CPUと1つのHopper GPUを組み合わせた。次に登場したのがGrace Blackwell(GB200)スーパーチップで、1つのGrace CPUと2つのBlackwell GPUを同一パッケージに収めた。Grace CPUはモジュール中央に位置し、図2-1に示すように2つのBlackwell GPUダイに囲まれている。

図 2-1. NVIDIA Grace Blackwell スーパーチップモジュール。1 つの Grace CPU(中央)と 2 つの Blackwell B200 GPU(左上と右上)を単一モジュール上に搭載。共有の統合メモリ空間を持ち、NVLink-C2C(チップ間)と呼ばれるカスタムスピードリンクで接続されている。

従来のシステムでは、CPUとGPUは別々のメモリプールを持ち、比較的低速なバス(PCIeなど)を介してコミュニケーションするため、データの往復コピーが必要となる。 NVIDIAのスーパーチップは、CPUとGPUをNVLink-C2C(チップ間接続)と呼ばれるカスタム高速リンクで接続することで、この障壁を解消している。

NVLink-C2Cは、GB200スーパーチップ内のGrace CPUとBlackwell GPU間で最大約900GB/sの転送速度を提供する。比較すると、PCIe Gen5 x16(Blackwell B200)は片方向あたり約64GB/s、PCIe Gen6 x16(Blackwell Ultra B300)は片方向あたり約128GB/sである。NVLink-C2Cの相互接続スピードは、一般的なPCIeよりも順序が桁違いに速い。 ...

Become an O’Reilly member and get unlimited access to this title plus top books and audiobooks from O’Reilly and nearly 200 top publishers, thousands of courses curated by job role, 150+ live events each month,

and much more.

Read now

Unlock full access