非线性特征化与

k

-

均值模型堆叠

|

95

将高维数据压缩为低维数据,常用于二维空间或三维空间中的可视化。

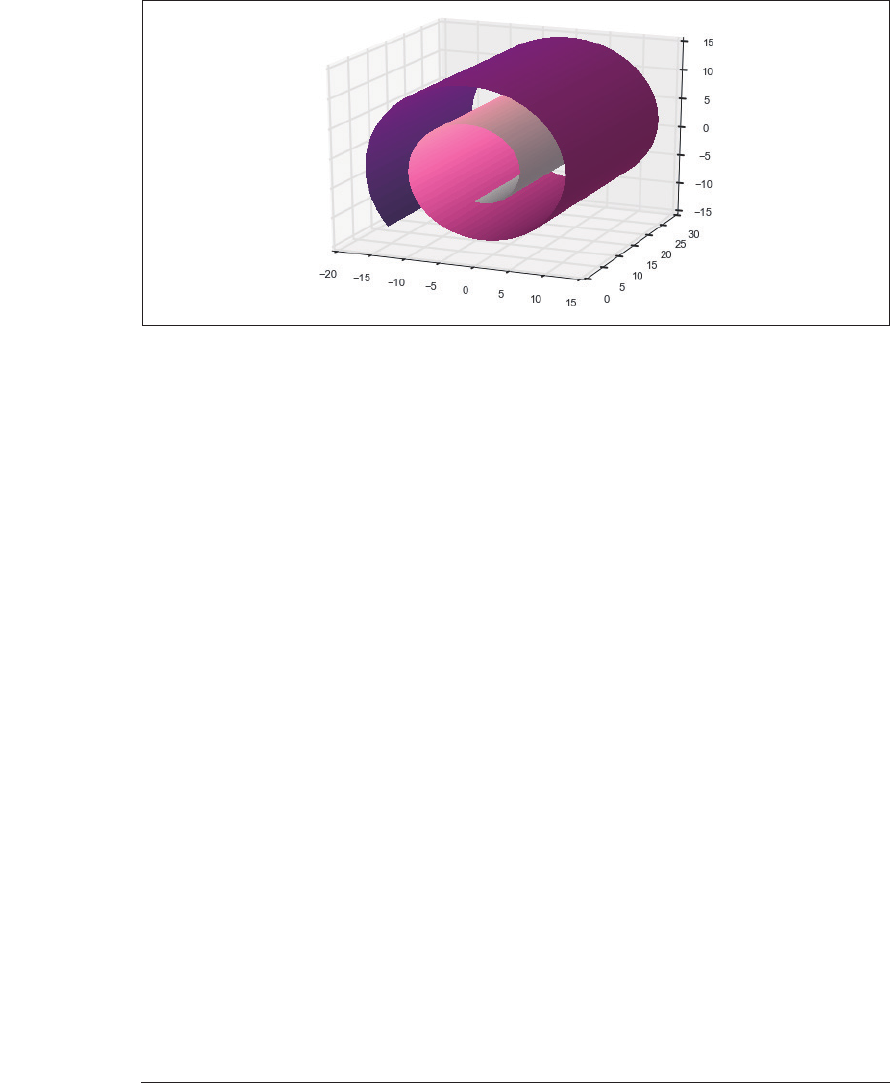

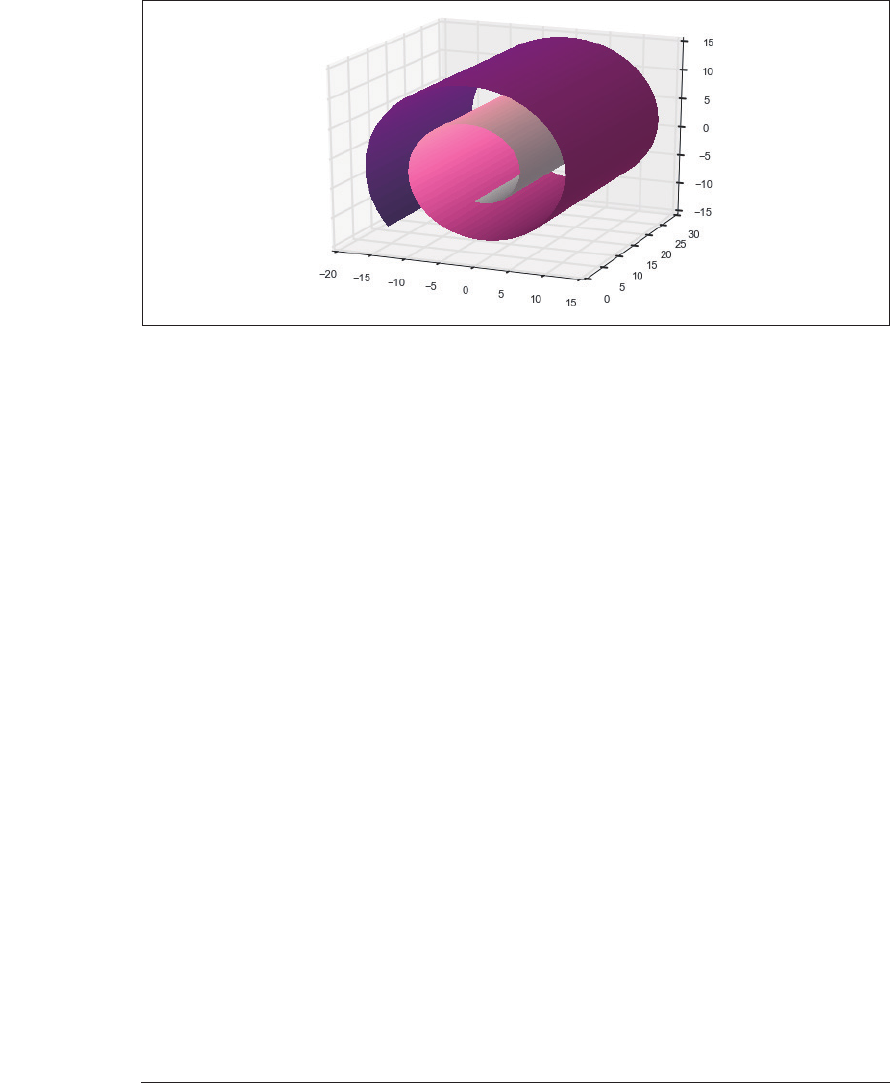

图 7-1:瑞士卷,一个非线性流形

但是,尽量降低特征维度只是特征工程目标的一小部分,它的根本目标还是为当前任务找

到

正确

的特征。在本章中,正确的特征是那些能表示出数据的空间特性的特征。

聚类算法通常不被用作局部结构学习技术,但实际上它完全可以胜任。彼此相近(可以用

一种特定的度量方式来定义“近”的概念)的点属于同一个簇。给定一个聚类,数据点可

以用它的簇成员向量来表示。如果簇的数量小于初始的特征数量,那么相对于初始表示,

这种新表示就具有更少的维度,初始数据就被压缩进一个更低维度的空间。本章将解释这

种思想。

与非线性嵌入技术相比,聚类会生成更多特征。但如果最终目标是特征工程,而不是可视

化,这就不是问题了。

我们将通过一种称为

k

-

均值的常用聚类算法来说明局部结构学习的思想,这种方法简单易

行。与其说

k

-

均值方法的作用是非线性流形降维,还不如说它执行了

非线性流形特征提

取

。使用正确的话,

k

-

均值聚类可以成为特征工程的一项神兵利器。

7.1

k

-

均值聚类

k

-

均值是一种聚类算法。聚类算法根据数据在空间中的分布方式为其分组。聚类是一种

非

监督

学习方法,它不需要任何形式的标签——这种算法的目的就是仅基于数据本身的结构

推测出簇标签。

聚类算法依赖于

度量方式

,即对数据点之间相近程度的测量。最常用的度量方式是欧氏距

离,或称欧几里得度量,它来自于欧氏几何,测量的是两点之间的直线距离。这种度量方