118

|

第

8

章

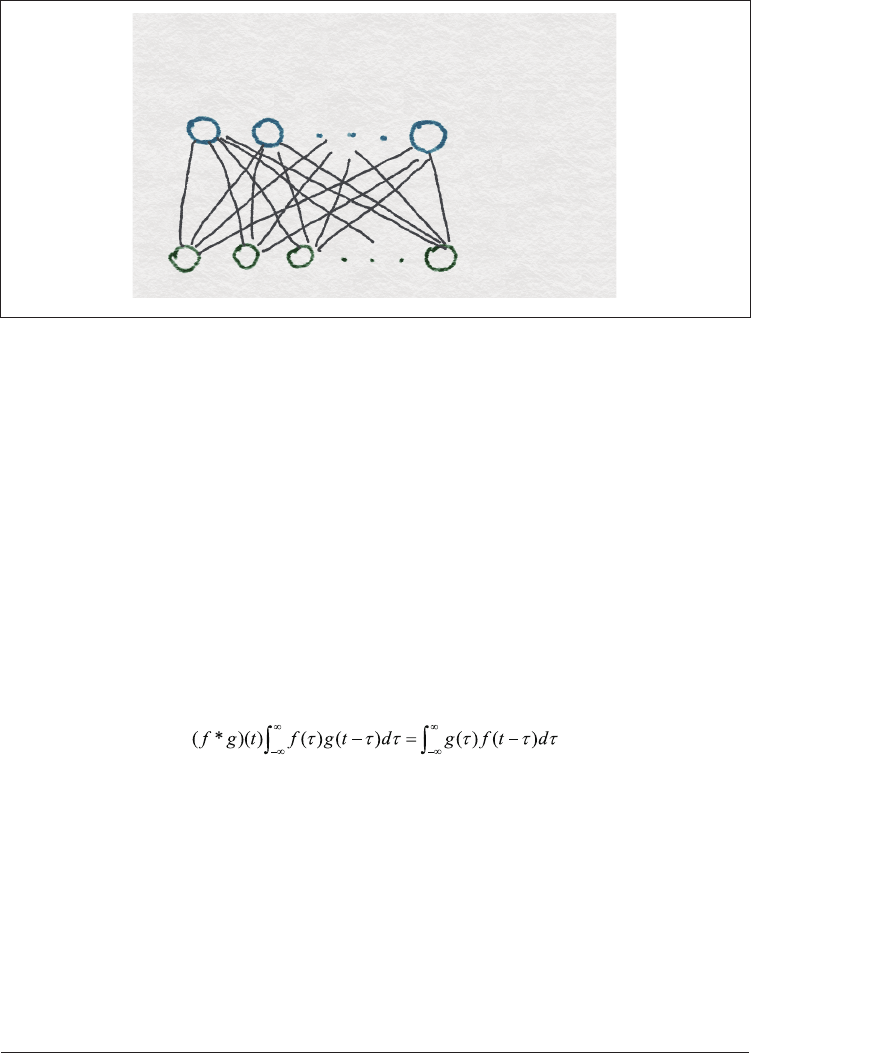

子集。)如果用图表示的话,全连接神经网络可以表示为一个完全二分图,其中每个输入

节点都连接到每个输出节点(见图

8-7

)。

全连接神经网络

输出

输入

图 8-7:全连接神经网络的图表示

全连接层包含最大可能数目的参数(输入数 × 输出数),因此它非常昂贵。如此密集的连

接可以让网络探测包含所有输入的全局模式。由于这个原因,

AlexNet

的最后两层是全连

接层。全连接层的输出彼此之间还是独立的,依输入情况而定。

8.3.2

卷积层

与全连接层不同,卷积层仅使用输入的一个子集来生成输出。转换过程在输入中“移动”,

每次使用若干特征生成输出。为简单起见,我们可以对不同输入集合使用同样的权重,而

不用为每个输入集合学习新权重。

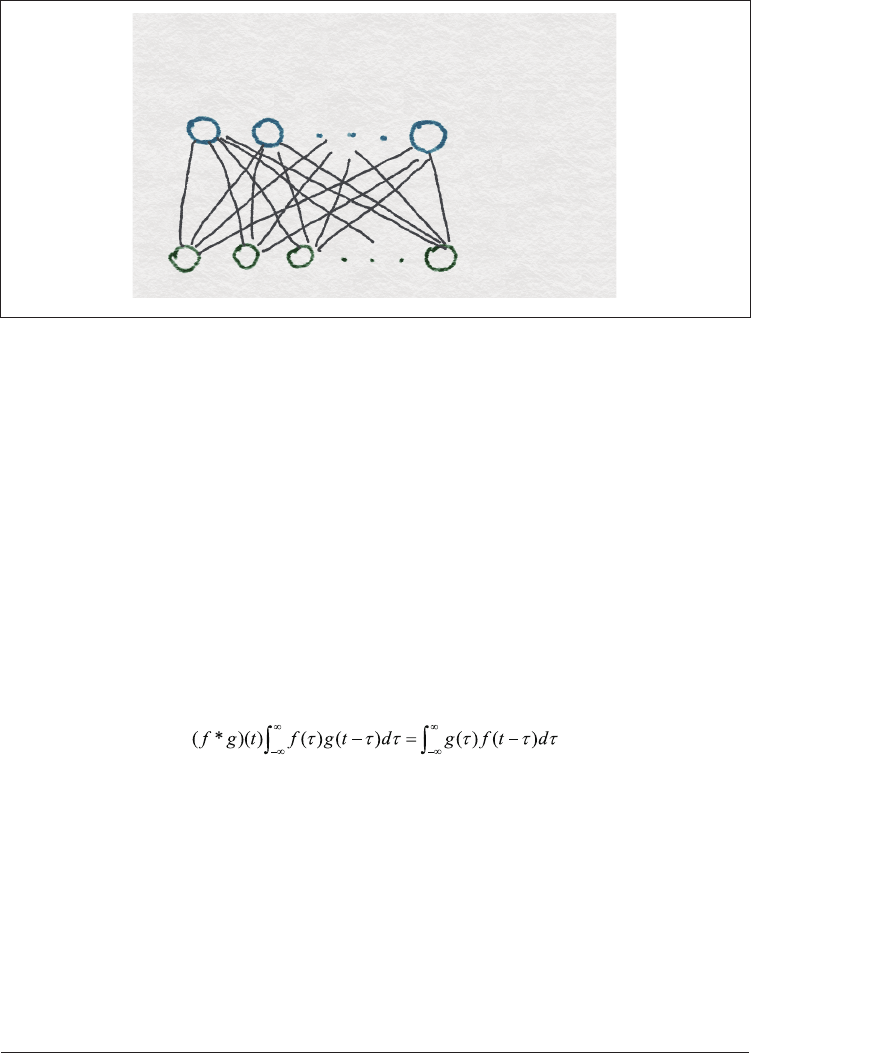

在数学上,卷积算子接受两个函数作为输入,生成一个函数作为输出。它要先翻转一个输

入函数,再将它沿着另一个函数移动,并输出在每个点上递增的曲线下的面积:

计算一条曲线下总面积的方法是求它的积分。这个算子对于输入是对称的,也就是说,翻

转第一个函数还是第二个函数都没有关系,输出是一样的。

在介绍图像梯度时(

8.2.1

节),我们已经见过了一个简单的卷积示例。但卷积的数学定义

还是显得有些复杂,这自有其原因。使用信号处理中的例子来解释卷积背后的思想是最容

易的。

假设有一个小黑盒。为了知道这个黑盒的用处,我们向它传递一个单位的刺激信号,然后

在一张纸上记录输出结果,直到再没有对初始刺激的反应为止。最后得到的随时间变化的