1

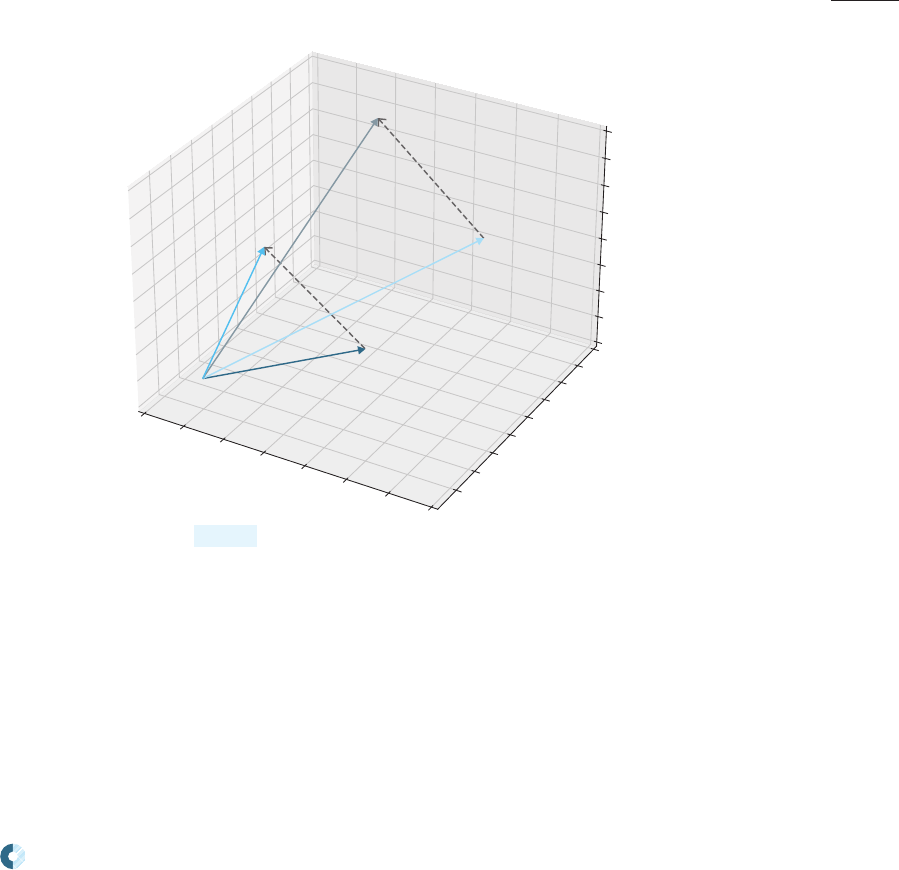

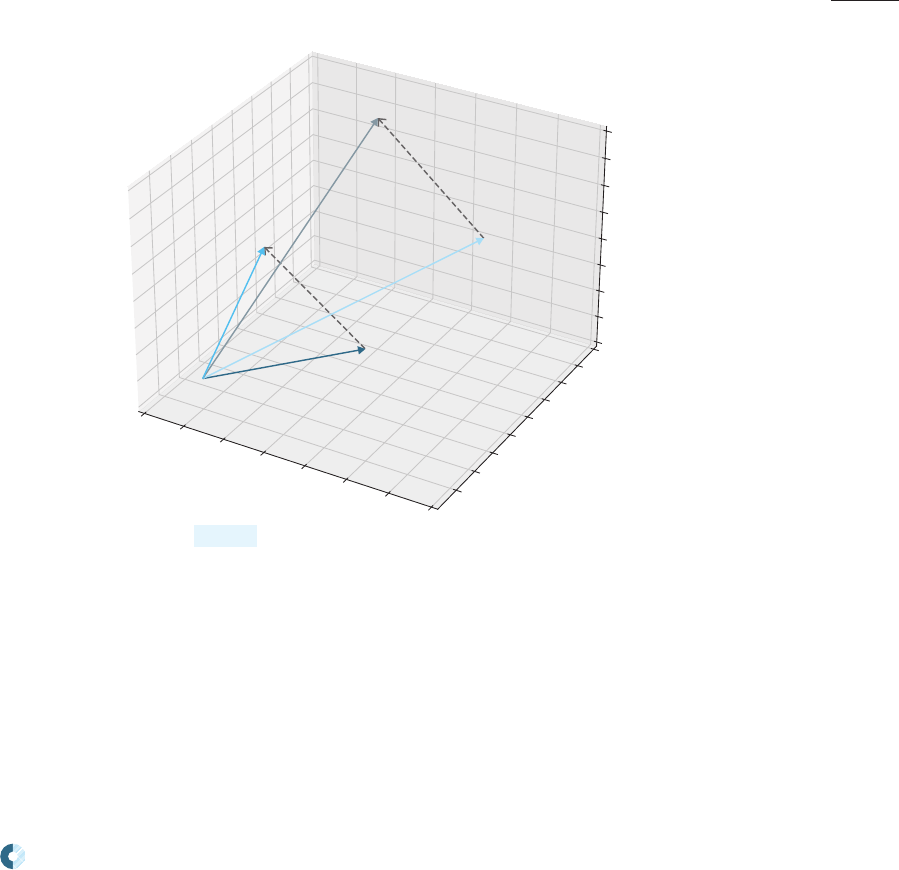

ベクトルが得られる様子を示しています。

図1.3.3

このように、ベクトル表現を用いることで単語の意味的な関係性も表すことができます。他

にも首都の概念を表す例として、Tokyo(東京)-Japan(日本)+France(フランス)=Paris

(パリ)といったものや、複数の概念を表す例として、Cats-Cat+Dog=Dogsといったものも

あります。

また、この埋め込み層では、各トークンが文章のどこに現れているのかを表す位置的な情報

もこのトークン埋め込みベクトルの列の情報に付与されます。これは、位置埋め込みと呼ば

れ、Transformerが文章の順序関係を理解するために重要な役割を果たします。

デコーダスタックの役割

デコーダスタックは、

n

個のトークン埋め込みベクトルを

n#D

model

の行列として入力とし、

様々な情報を付与した

n

個のトークン埋め込みベクトルを出力します。ここで加えられる情

報には、トークン間の関連性や文章の文脈などが含まれます。

例として、

'彼', 'は', '新しい', '黒い', '車', 'を', '買っ', 'た', '。'

というトー

クン列が入力された場合を考えてみましょう。この場合、

' 新しい '

と

'黒い'

という形容詞は

'車'

という名詞を修飾しているため、これらのトークン間には強い関連性があります。この

041

1.3

Transformerの仕組み