2

LLMの事前学習

2.2

事前学習は、はじめに行われるLLM の学習です。この段階では、モデルは大規模なテキス

トデータを用いて、言語の一般的な特徴や構造を学習します。事前学習の主な目的は、モデル

に様々な汎用的な能力を与えることです。例えば、LLMの事前学習では、Webページから収

集された大量のテキストデータで学習させることで、質問応答、翻訳、言語理解、要約のタス

クができるようになるとされています[Radford et al. 2019]。

2.2.1

事前学習用データ

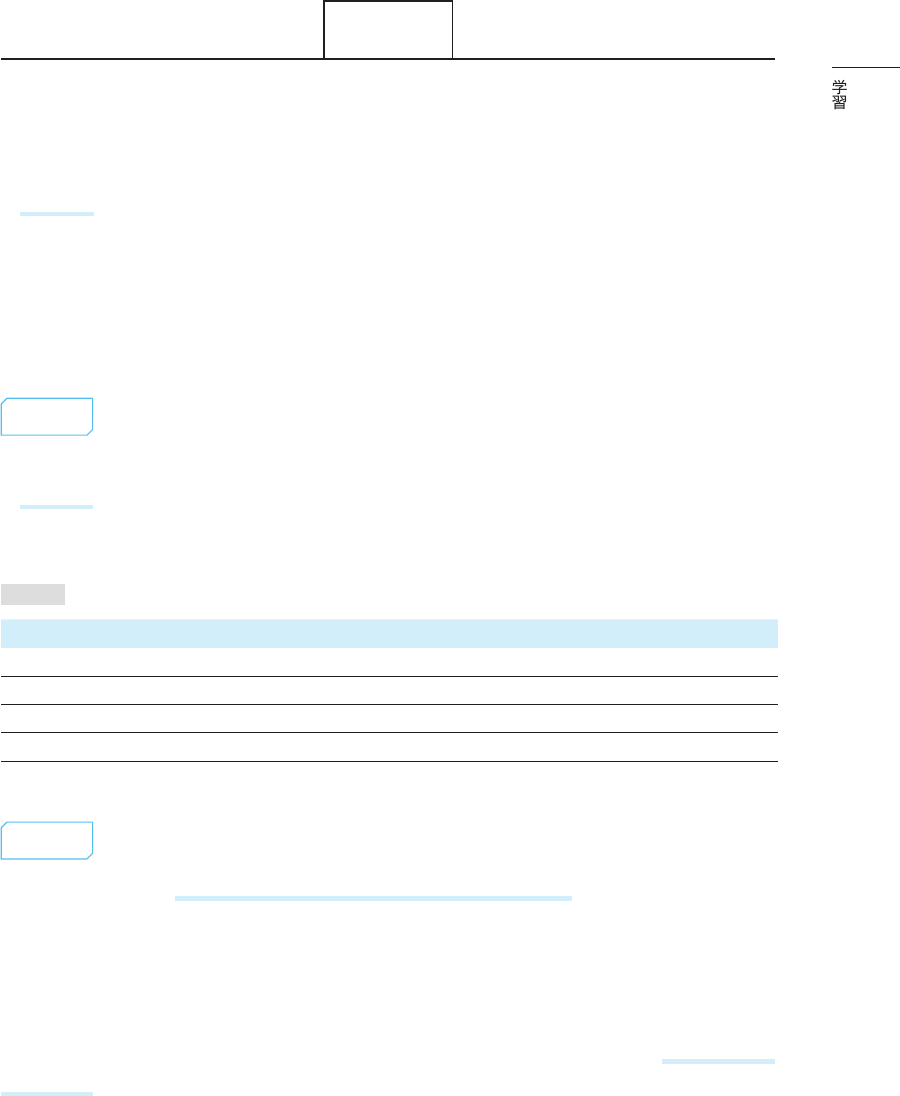

事前学習には、主にインターネット上のWebページ、書籍、論文など、多様的かつ大規模

なコーパスが使用されます。コーパスとは、言語学習のために収集されたテキストデータのこ

とです。表2.2.1 に、いくつかの LLMの事前学習に使用されるコーパスの例を示します。

表2.2.1

モデル名 コーパス

GPT-3 約4,500 億トークン(インターネット上の Webページ、書籍、記事など)[Brown et al. 2020]

GPT-4 約58 兆トークン(インターネット上の Webページ、書籍、記事など)[OpenAI et al. 2024]

BERT 約33 億単語(BookCorpus と英語版Wikipedia)[Devlin et al. 2019]

T5 約7,500 億トークン(Web ページ、書籍、記事、その他のデータセット)[Raffel et al. 2023]

2.2.2

自己教師あり学習

LLM