1

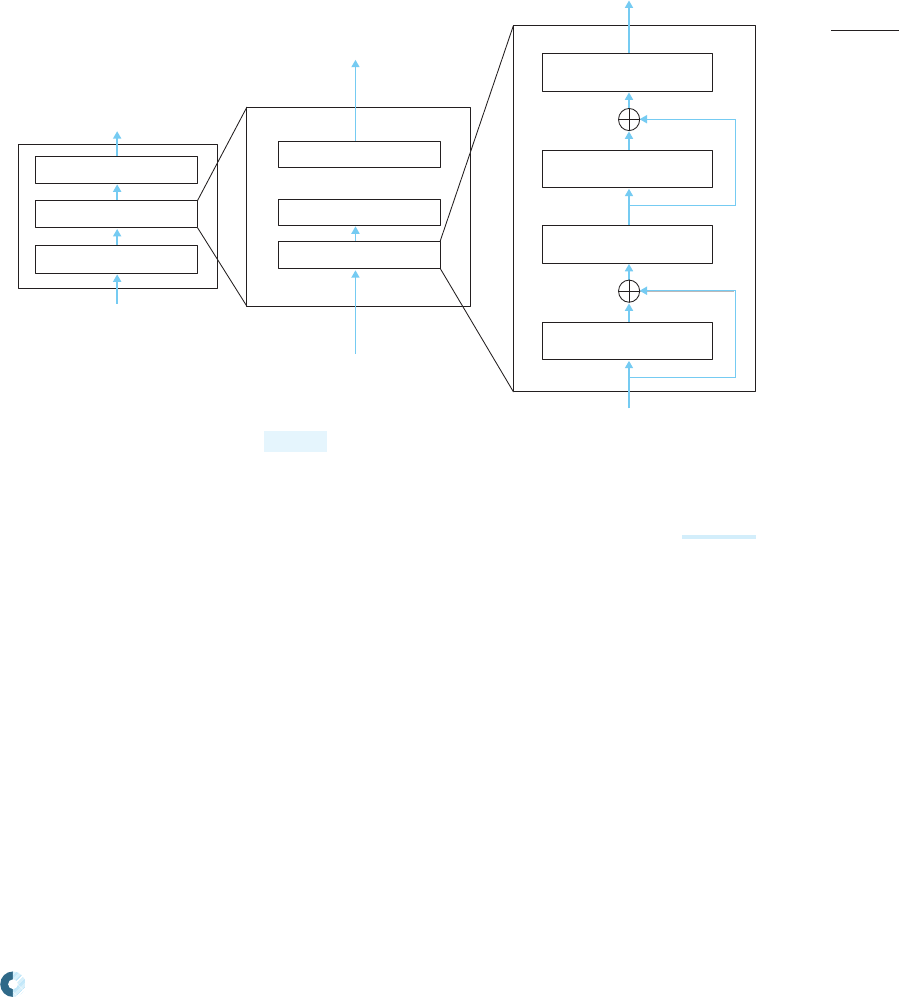

図1.3.8

マスク付きマルチヘッド注意機構ではトークン間の関連性を計算し、フィードフォワードで

は出力埋め込みベクトルに非線形の計算を適用します。これらが計算した情報は、残差接続を

通して入力埋め込みベクトルに対して加算されます。加算のたびにレイヤ正規化が適用され、

出力埋め込みベクトルが更新されることになります。なお、GPT-3の場合、このレイヤ正規

化は、各サブレイヤの後ではなく前に配置されています。デコーダに入力されたトークン埋め

込みベクトルは、デコーダスタックを通過するごとに、様々な情報が付与され、最終的に出力

埋め込みベクトルが得られます。

デコーダスタックのように同じサブコンポーネントを重ねる構成は、ディープラーニングに

おいて一般的な構成です。入力に近い層ほど具体的な情報を扱い、出力に近い層ほどより抽象

的な情報を扱うようになっています。デコーダスタックも同様に、入力埋め込みベクトルに対

して具体的な情報を付与する処理を繰り返し、最終的に抽象的な情報を持つ出力埋め込みベク

トルを得るように設計されています。

以降、本項ではマスク付きマルチヘッド注意機構層とフィードフォワード層について詳しく

説明します。

マスク付きマルチヘッド注意機構

マスク付きマルチヘッド注意機構は、その名前の通りマルチヘッドのマスク付き注意機構か ...