412 | Capítulo 14: Redes Neurais Recorrentes (RNN)

de ativação) no topo de cada saída (mas isso não afeta o estado da célula). Todas essas

camadas totalmente conectadas compartilham os mesmos pesos e termos de polarização

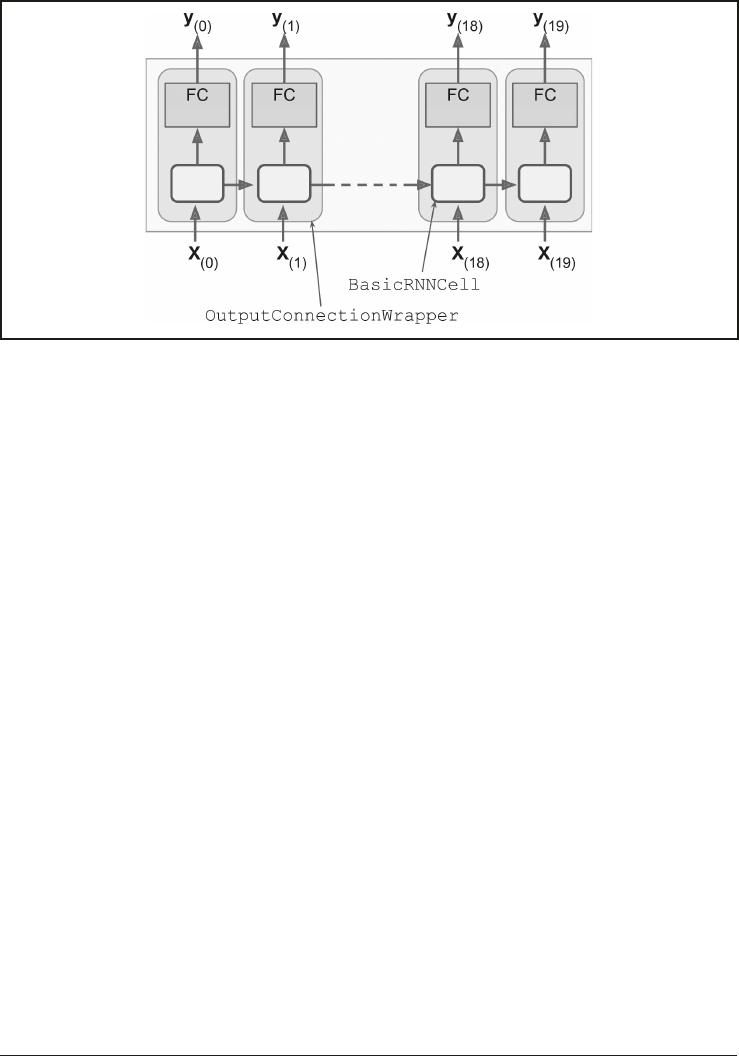

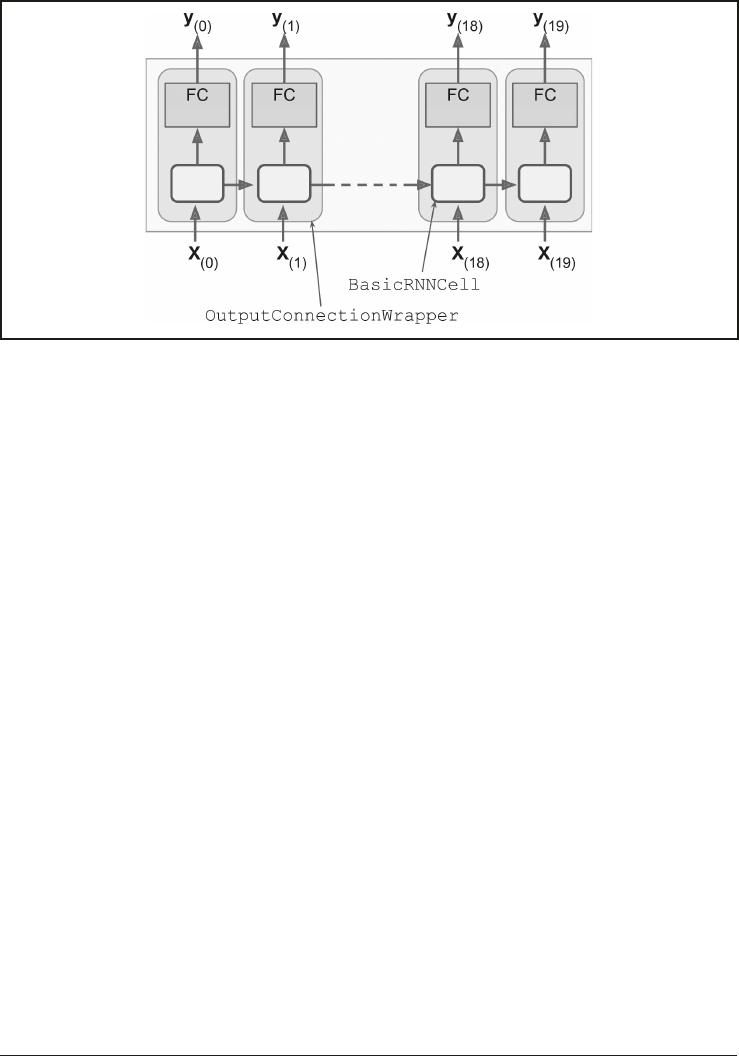

(treináveis). A RNN resultante é representada na Figura 14-8.

1 unidade 1 unidade

1 unidade 1 unidade

Figura 14-8. Células RNN utilizando projeções de saída

Envolver uma célula é bem fácil. Ajustaremos o código anterior envolvendo o

BasicRNNCell em um OutputProjectionWrapper:

cell = tf.contrib.rnn.OutputProjectionWrapper(

tf.contrib.rnn.BasicRNNCell(num_units=n_neurons, activation=tf.nn.relu),

output_size=n_outputs)

Por enqua