240 8 章 線形代数

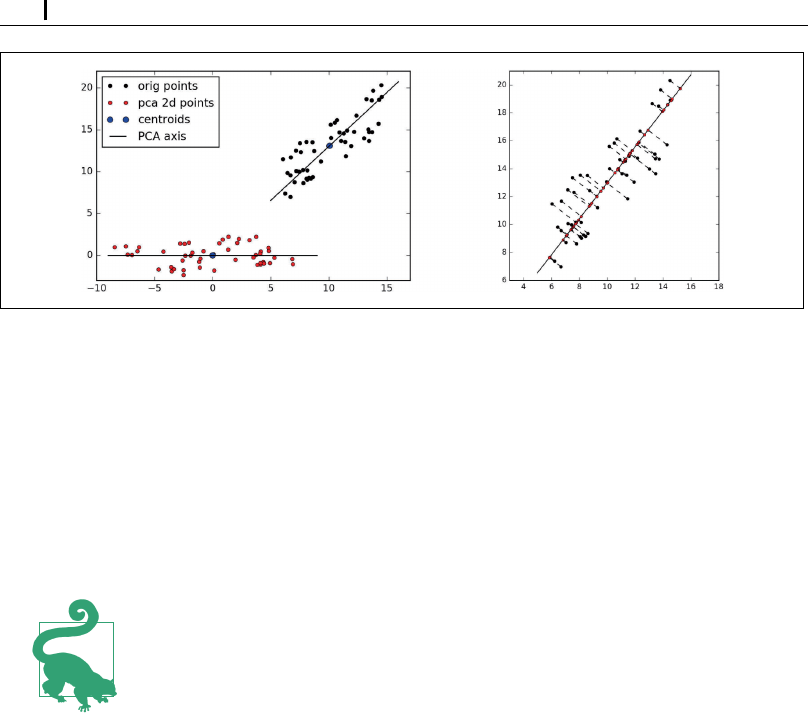

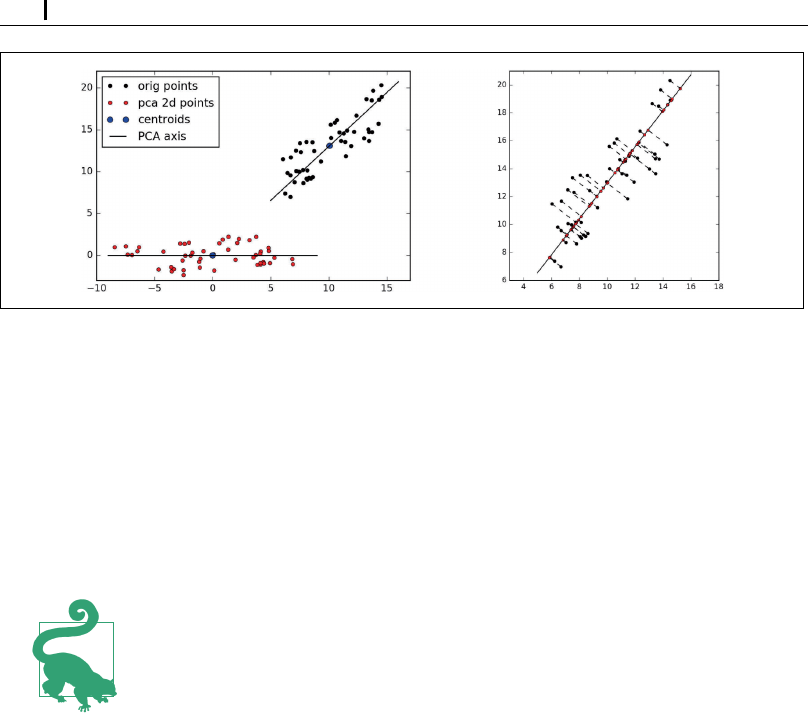

図 8 -16 PC

A は、黒い点を直交する軸に射影し、それを回転して赤い代替表現を生成する(左)。個々の

成分の値は、適切な軸に個々の点を射影して求める(右)

ベクトルのうち相関性の高いものを 1 つにまとめて次元数を減らしながら、それらの特徴ベクトルを線形結

合して新しい特徴ベクトルを作っていく。統計因子分析は、分散の大部分を説明する最も重要(相関という

尺度で)な直交次元を明らかにしてくれる。

点の集合の基本構造は、比較的少数の成分で十分捉えることができる。未処理の部分はノイズの可能性が

高いので、データから取り除いた方がかえって良い場合が多い。PCA(または SVD)で次元削減すると、単

に次元数が減るだけでなく、もとのデータよりもクリーンなデータが得られる。

今後の課題

PCA と S

VD は、アプローチは異なるが、本質的に同じものを計算する。特徴行列の低次元行列

による近似ではどちらも同じように効果を発揮する。

8.6 私の体験談から:ヒューマンファクター

共著書の Who’s Bigger? のために歴史的偉人の分析をしていたときに、PCA や SVD といった次元削減手

法の威力に初めて触れて衝撃を受けた。4.7 節の「私の体験談から」でも紹介したように、我々は Wikipedia

の構造とコンテンツを分析し、英語版に掲載されている 80 万人分以上の項目から PageRank や記述の長さ

といった 6 種類の特徴を抽出することにした。これにより、個々の人物は