266 9 章 線形回帰とロジスティック回帰

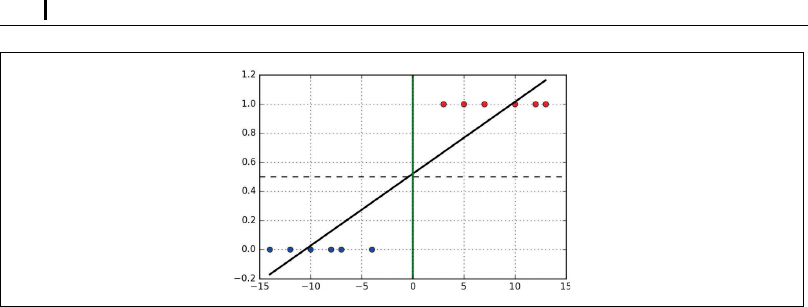

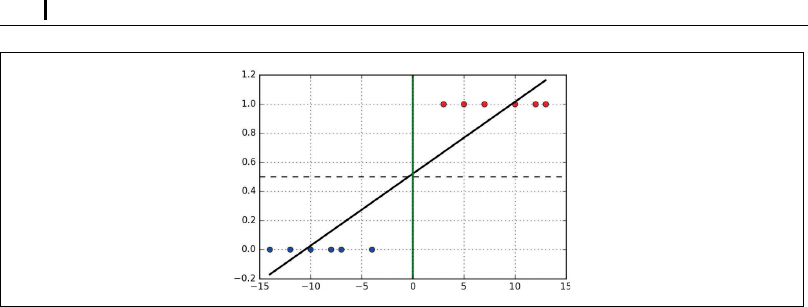

図 9 -12 完璧な境界線 x =

0 があっても、最適な回帰式はクラスを 2 つに分割する

• male(男性)= 0 / female(女性)= 1

• democrat(民主党)= 0 / republican(共和党)= 1

• spam(スパム)= 1 / non-spam(スパムでない)= 0

• cancer(悪性腫瘍)= 1 / benign(良性腫瘍)= 0

陰性(クラス 1)は、一般に要素数が少ないクラス、つまりより特殊な条件を示す。ここでの陽性/陰性に

価値判断は含まれない。クラスのサイズが同じなら、どちらを陽性にするかは適当に決める。

ターゲット値がこの 0 または 1 のラベルになっている特徴ベクトル x に対し、図 9 -12 のように回帰式

f(x) を訓練することについて考えてみよう。ここには少しロジックがある。陽性の訓練データに似ている

データ例は、陰性のデータ例に近いデータよりもスコアが小さくなるはずだ。f(x) が返した値を、しきい

値としてラベルを決めればよい。f(x) ≦ 0.5 なら x は「陽性」、f(x) > 0.5 なら x には「陰性」ラベルを与

える。

しかし、このような決定方法には問題がある。訓練データに「陰性」データをいくつか追加したとする。

すると、回帰式は「陰性」標本に影響され、境界線に近いデータの分類が怪しくなる。もとのままでもこれ

ら陰性データは正しく分類できていたので、残念な結果となる。本来は、クラスを貫く線ではなく、異なる ...