338 11 章 機械学習

らの

ベクトルが分離平面を「サポートする」(支える)ことに由来する。LibLinear や LibSVM といった効

率のよいソルバの最適化アルゴリズムは、分離平面になりそうなものを定義するサポートベクターの部分集

合を拾い出し、その中から最も幅の広いものを選ぶ。

実は、SVM にはもっと一般的な最適化基準がある。これは、幅の広い分離平面を追求する一方で、誤分

類された点にペナルティを与える(誤分類を禁止しない)。このように 2 つの目標(分離平面を太くするこ

とと誤分類を減らすこと)を掲げ、定数を使って両者のバランスを取る関数は、一種の正則化と考えること

ができる。この種の一般的な問題は、勾配降下探索を使って解くことができる。

11.4.2 非線形サポートベクターマシン

SVM は、2 つのクラスの点を分離する超平面を定義する。面は高次元における線であり、線形代数を使っ

て定義できる。では、このような線形の手法からどのようにして非線形の決定境界を生み出すのだろうか。

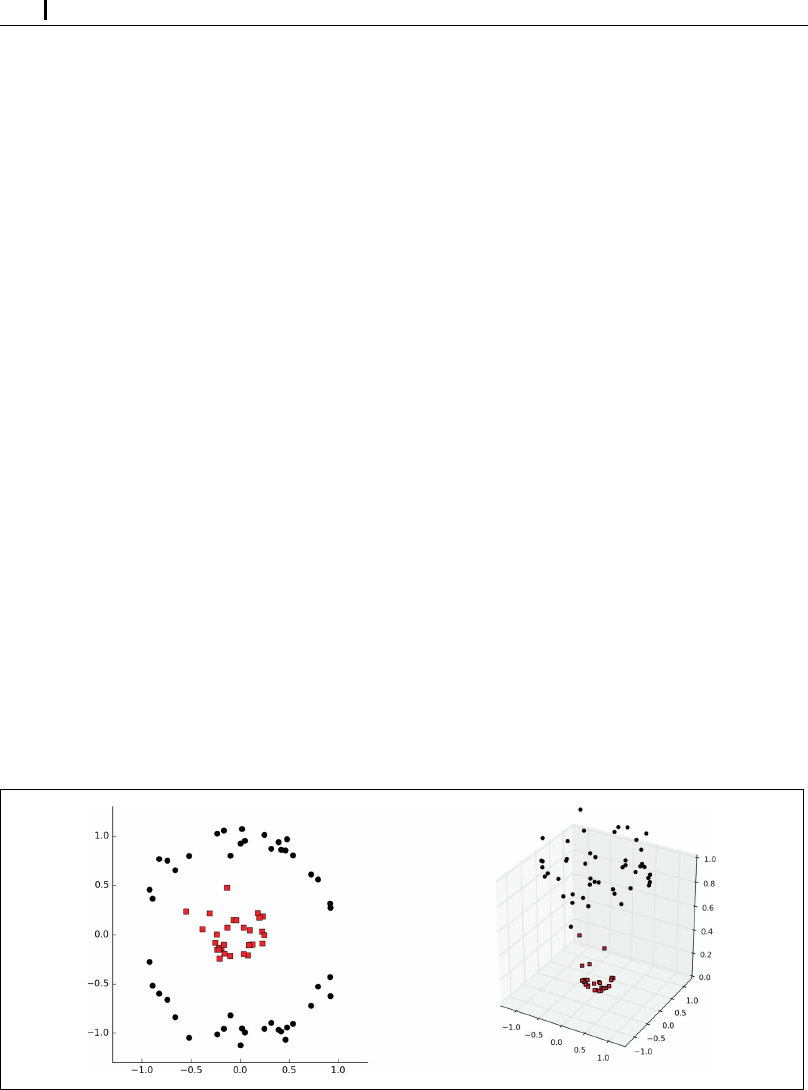

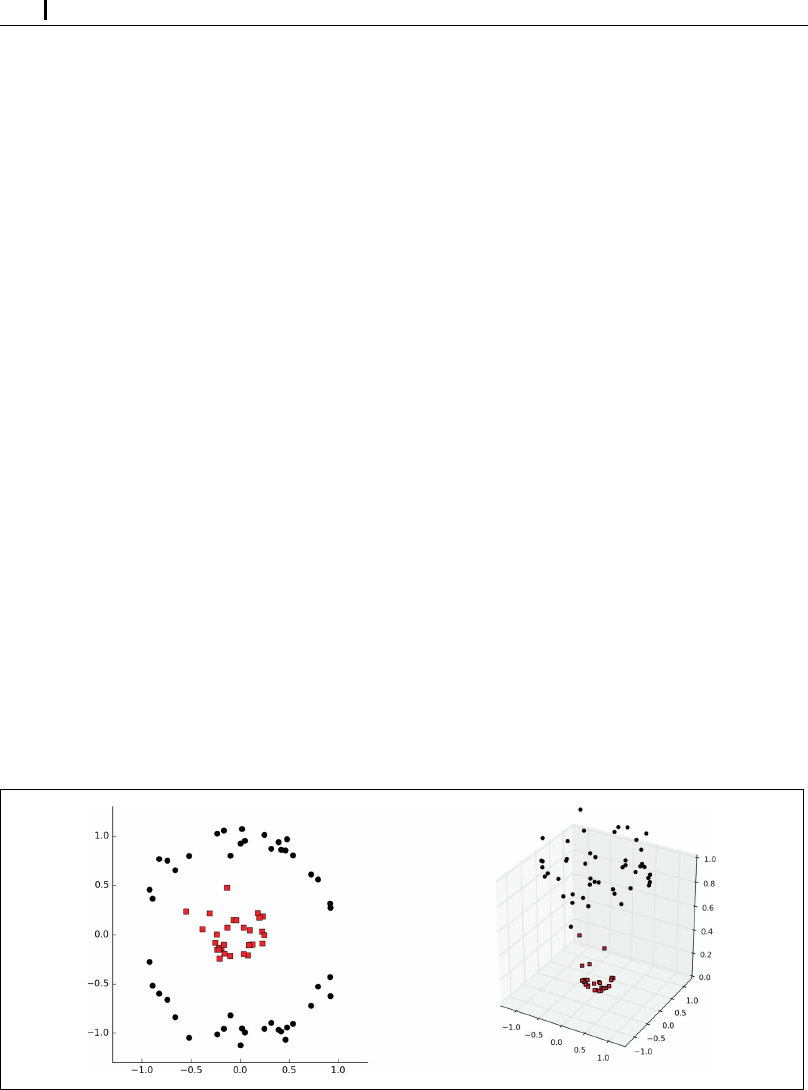

与えられた点の集合が最大マージンの境界線を持つためには、まず第 1 に 2 つの色が線形に分割できなけ

ればならない。しかし、これまでにも述べたように、常に分割できるとは限らない。赤点のクラスタが黒点

の円形クラスタに囲まれている図 11 -10(左)のような複雑な条件について考えてみよう。例えば、現在地

から近いかどうかによって旅行の目的地を日帰り圏内と長距離に分ける場合を想像してみよう。候補地それ

ぞれの緯度と経度は、図 ...